谷歌公开最新极限压缩算法 TurboQuant破解内存瓶颈

沄森™2026-03-27

破解算力问题,降低模型所需的存算空间,可以通过多种途径实现,比如减少训练或推理时的算力需求。稀疏化、量化、压缩和蒸馏等方法都是常用手段。不同企业和研究机构会根据各自的需求选择不同的策略

谷歌公开最新极限压缩算法 TurboQuant破解内存瓶颈。破解算力问题,降低模型所需的存算空间,可以通过多种途径实现,比如减少训练或推理时的算力需求。稀疏化、量化、压缩和蒸馏等方法都是常用手段。不同企业和研究机构会根据各自的需求选择不同的策略。

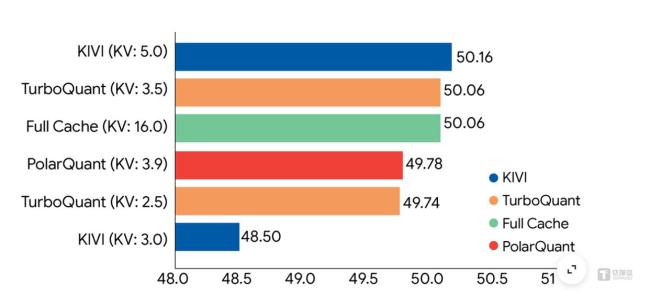

以长上下文任务为例,过去两年中,AI算法团队提出了一种基于键值缓存(KV Cache)的分离架构设计,将预填充服务器与解码服务器分开。这种设计在大batch size及队列场景下需要更大的系统内存带宽。许多推理任务的瓶颈在于内存带宽。

谷歌最近发布了一项名为TurboQuant的算法,旨在解决大模型运行时的内存消耗问题。该技术的核心是让AI在思考和回答问题时占用更少的工作内存,同时保持几乎相同的智力水平,甚至速度更快。官方表示,TurboQuant的推出将带来多项好处:百万Token上下文成本显著下降;向量数据库领域更容易实现实时索引和亚毫秒查询;边缘AI领域中手机和嵌入式设备的上下文推理更加实际。此外,这项技术还可以扩展到多模态领域的向量压缩。

TurboQuant的发布对存储市场产生了影响。美股存储板块如美光科技、闪迪等公司股价应声下跌。近年来,由于数据中心建设扩张需求激增,内存(RAM)、固态硬盘(SSD)和硬盘驱动器(HDD)等存储产品出现供应短缺和价格上涨。市场反应表明,TurboQuant一旦广泛应用,可能会显著改变对未来AI推理服务器中内存容量规格的需求判断,重塑相关硬件的成本曲线。

所有文章未经授权禁止转载、摘编、复制或建立镜像,违规转载法律必究。

举报邮箱:1002263188@qq.com