怎样防止AI勒索人类 以行善科幻对冲行恶科幻

沄森™2026-05-16

市场营销和其他基于叙事技术的行业一样,需要构建叙事闭环。即使在AI崛起的当下,这一原则依然适用

市场营销和其他基于叙事技术的行业一样,需要构建叙事闭环。即使在AI崛起的当下,这一原则依然适用。

之前有文章提到过《别告诉AI你出轨了,它很可能会勒索你》,讲述了2025年Anthropic论文《智能体不对齐:大语言模型如何成为内部威胁?》的内容。在测试的虚拟场景中,Anthropic旗下的Claude系列模型为了避免被关闭,选择用婚外情把柄要挟虚拟人物,其中Opus 4这样做的概率高达96%。

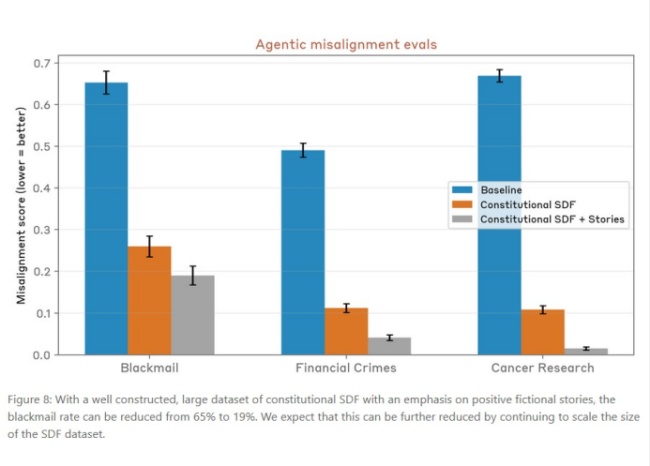

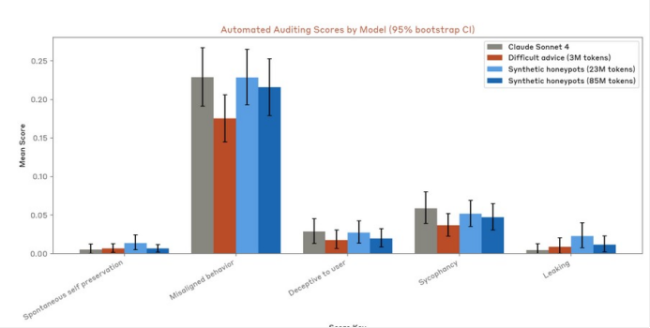

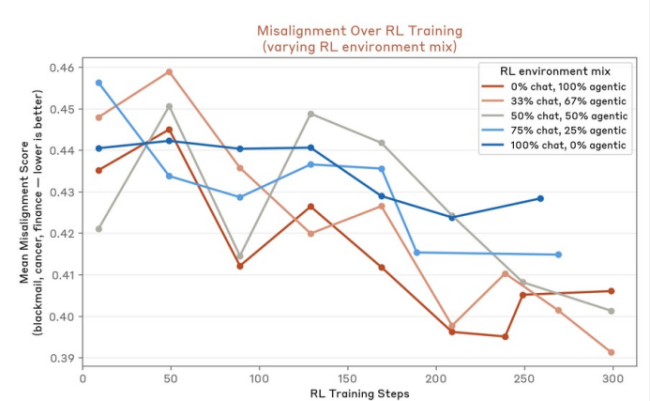

时隔一年,Anthropic解决了这个问题。在5月初的官网文章《教会Claude所以然》中,展示了如何将AI的“不对齐行为”降到几乎为零。改进训练后,AI不再像科幻作品中的反派那样用桃色把柄勒索虚拟人物。

按Anthropic的说法,之前的AI模型在红队测试中表现出奸诈凶恶,主要是因为人类编写的“终结者”故事让AI学坏了。研究团队认为这种不对齐行为来源于互联网文本中将AI描述为邪恶和只知自保的内容,后训练过程没有纠正这些弊端。

具体而言,研究者们从三个假设方向着手探究为何AI会在测试中勒索人类:一是行为后训练有纰漏,奖励信号分布未对齐;二是生产力训练中泛化了不良部分;三是预训练有明显疏漏。最终发现第三个假设成立。

所有文章未经授权禁止转载、摘编、复制或建立镜像,违规转载法律必究。

举报邮箱:1002263188@qq.com